Observability

llm.port hilft dir, den AI-Betrieb im Alltag schnell zu verstehen.

Du kannst damit Fragen beantworten wie:

- Sind Requests stabil und schnell?

- Welche Modelle werden am meisten genutzt?

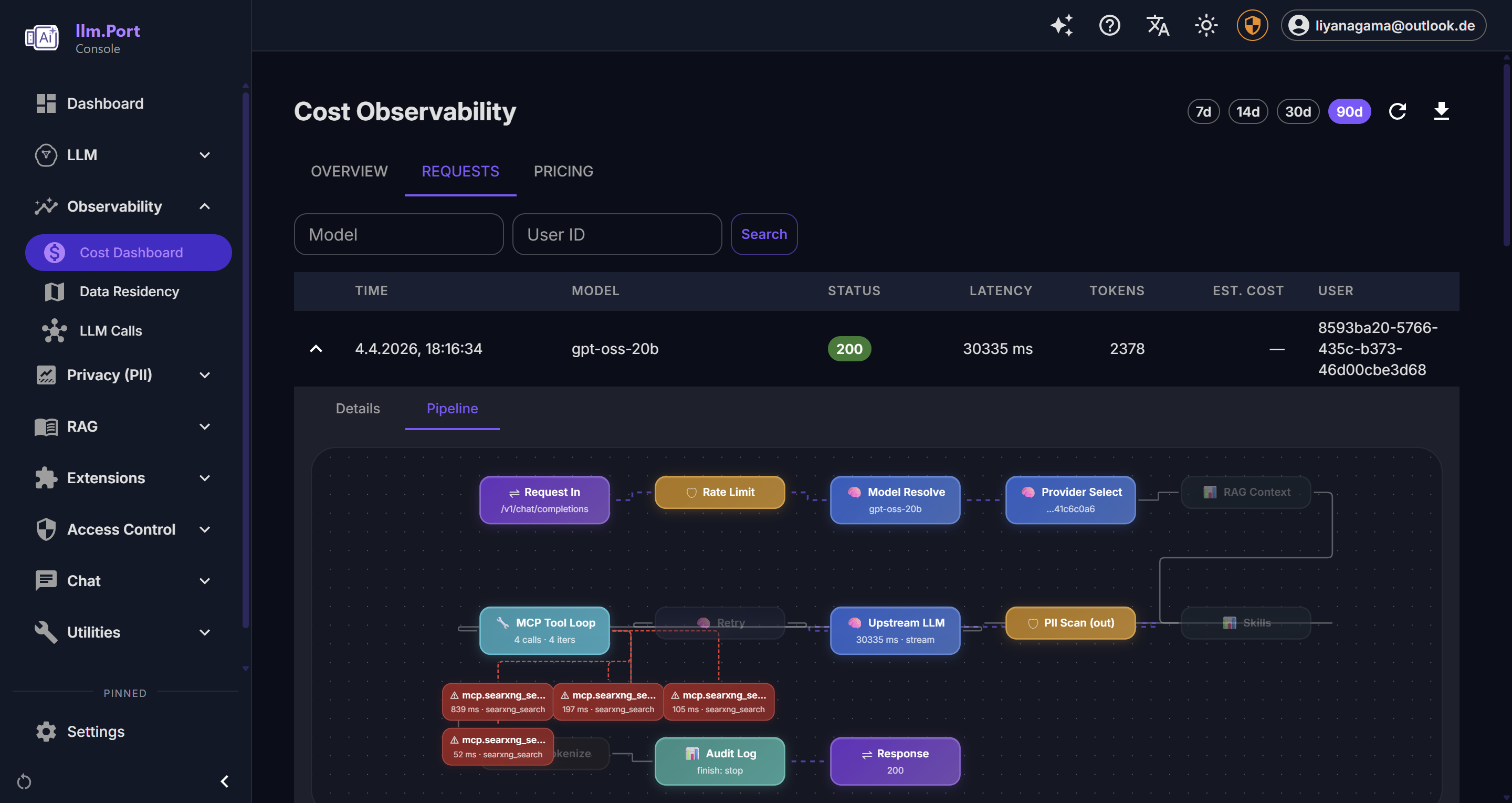

- Wo steigen die Kosten?

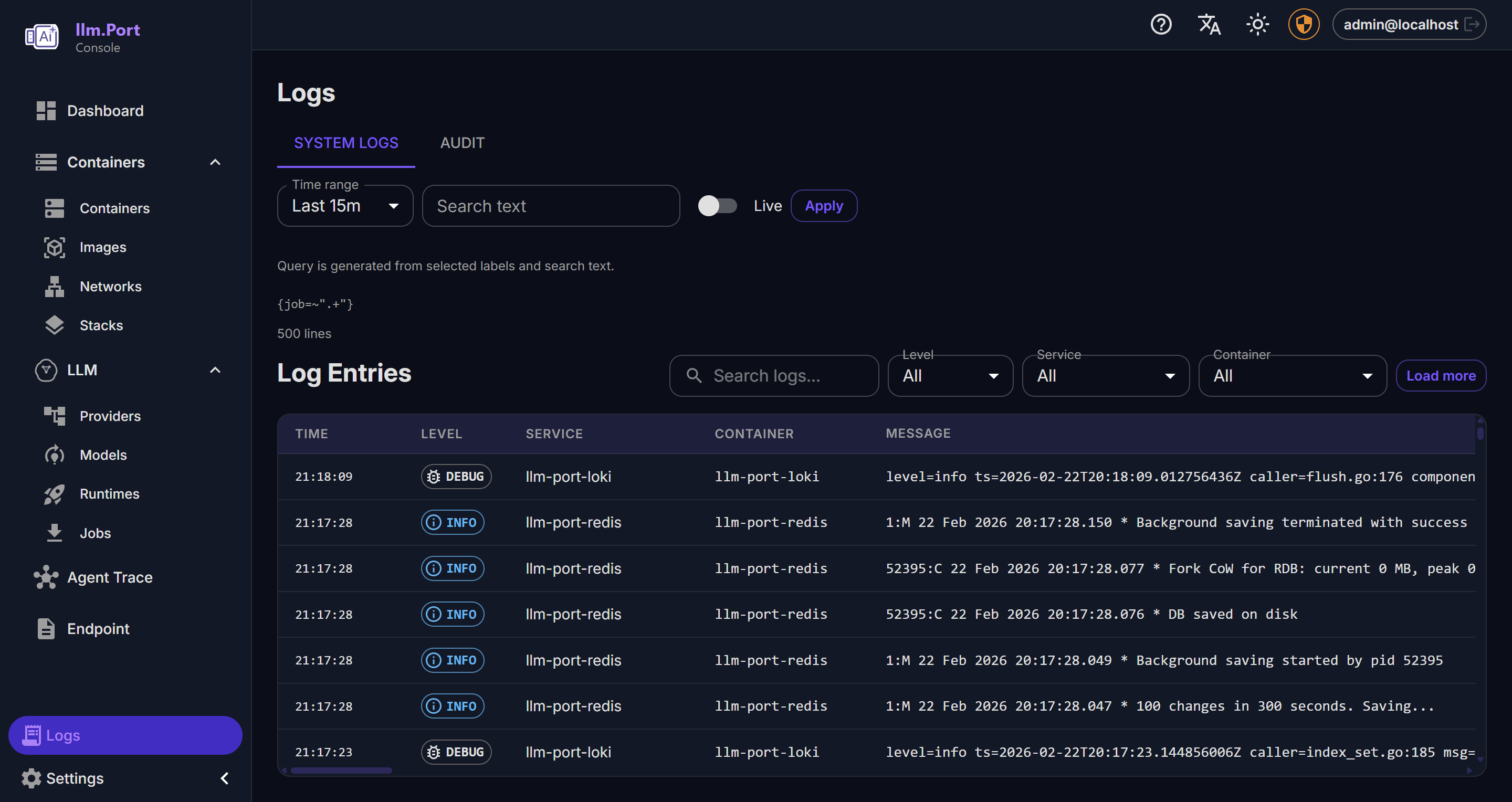

- Wer hat was wann geaendert?

What you can observe

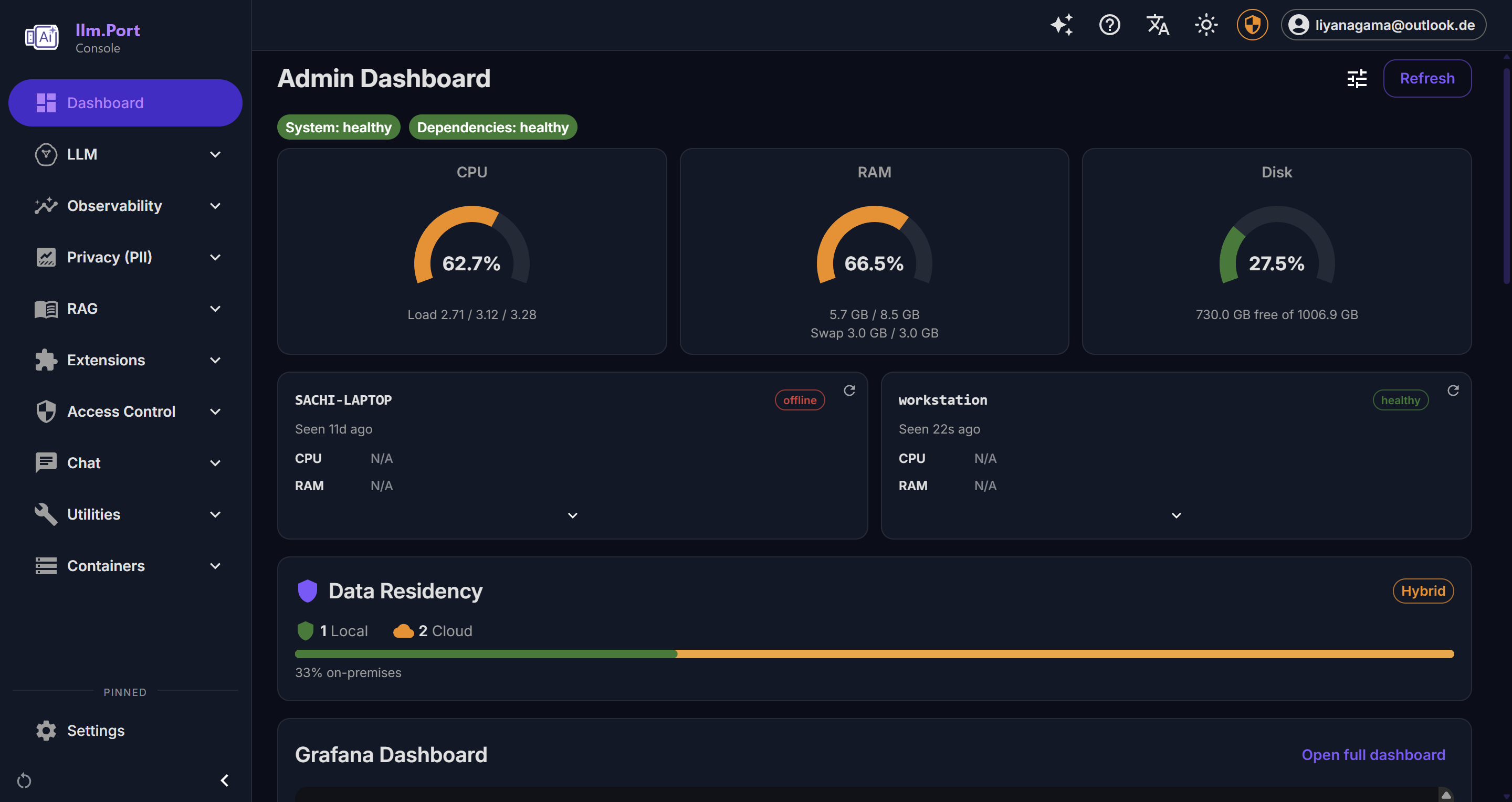

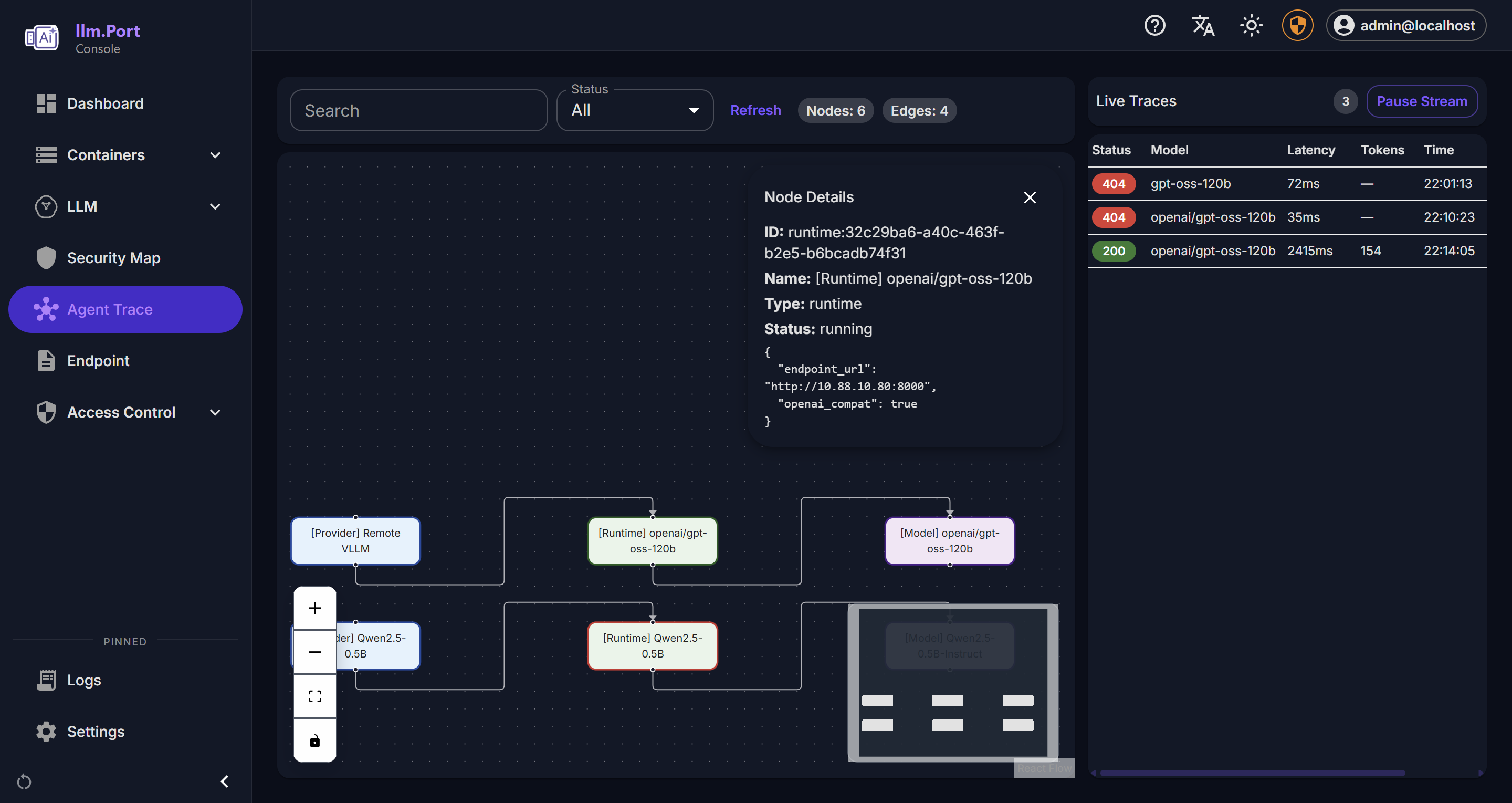

- Request activity and outcome trends

- Latency and throughput indicators

- System health and service behavior

- Administrative action trails

Why this matters

- Faster incident detection and troubleshooting

- Better governance and compliance reporting

- Data for capacity planning and optimization

Fuer viele Teams wird das zur zentralen Quelle fuer den operativen AI-Betrieb.

Recommended operating practice

- Define alert thresholds for key service indicators

- Review usage and access trends regularly

- Keep retention policies aligned with compliance requirements

Im Requests-Bereich kannst du Nutzerprobleme oft am schnellsten nachvollziehen.

Public docs focus on observable outcomes and operating guidance, not internal telemetry plumbing.

Screenshots