llm.Port

Self-hosted all-in-one LLM platform

Leitet, sichert und überwacht den Datenverkehr zwischen lokalen LLM-Runtimes und Remote-Anbietern — und gibt Teams einen zentralen Ort zur Verwaltung von LLM-Diensten.

# Install the CLI

$ pip install llmport-cli

# Check prerequisites & deploy

$ llmport doctor

$ llmport deploy

# Enable optional modules

$ llmport module enable pii

$ llmport module enable ragVerfügbar in English, Deutsch, Español, 中文

So funktioniert es

API-Gateway

OpenAI-kompatibler /v1/*-Endpunkt. Leitet Anfragen an vLLM, llama.cpp, Ollama, TGI und Remote-Anbieter (OpenAI, Azure, …) weiter. SSE-Streaming, alias-basierte Modellauflösung, Retry und Rate-Limiting.

PII-Schicht

Microsoft Presidio-Integration für Echtzeit-Erkennung und -Schwärzung. Mandantenspezifische Richtlinien mit konfigurierbaren Entitätstypen und Fail-Safe-Modi.

GPU-Orchestrierung

Automatische Erkennung von NVIDIA (CUDA), AMD (ROCm) und Intel GPUs. Startet vLLM-Container mit dem korrekten Image (CUDA / ROCm / Legacy). HuggingFace-Cache-Mounting für schnelles Laden von Modellen.

Speicher

PostgreSQL mit pgvector für Vektorsuche (RAG). Redis für Rate-Limiting, Sitzungscache und verteiltes Leasing. MinIO für S3-kompatiblen Dokumentenspeicher.

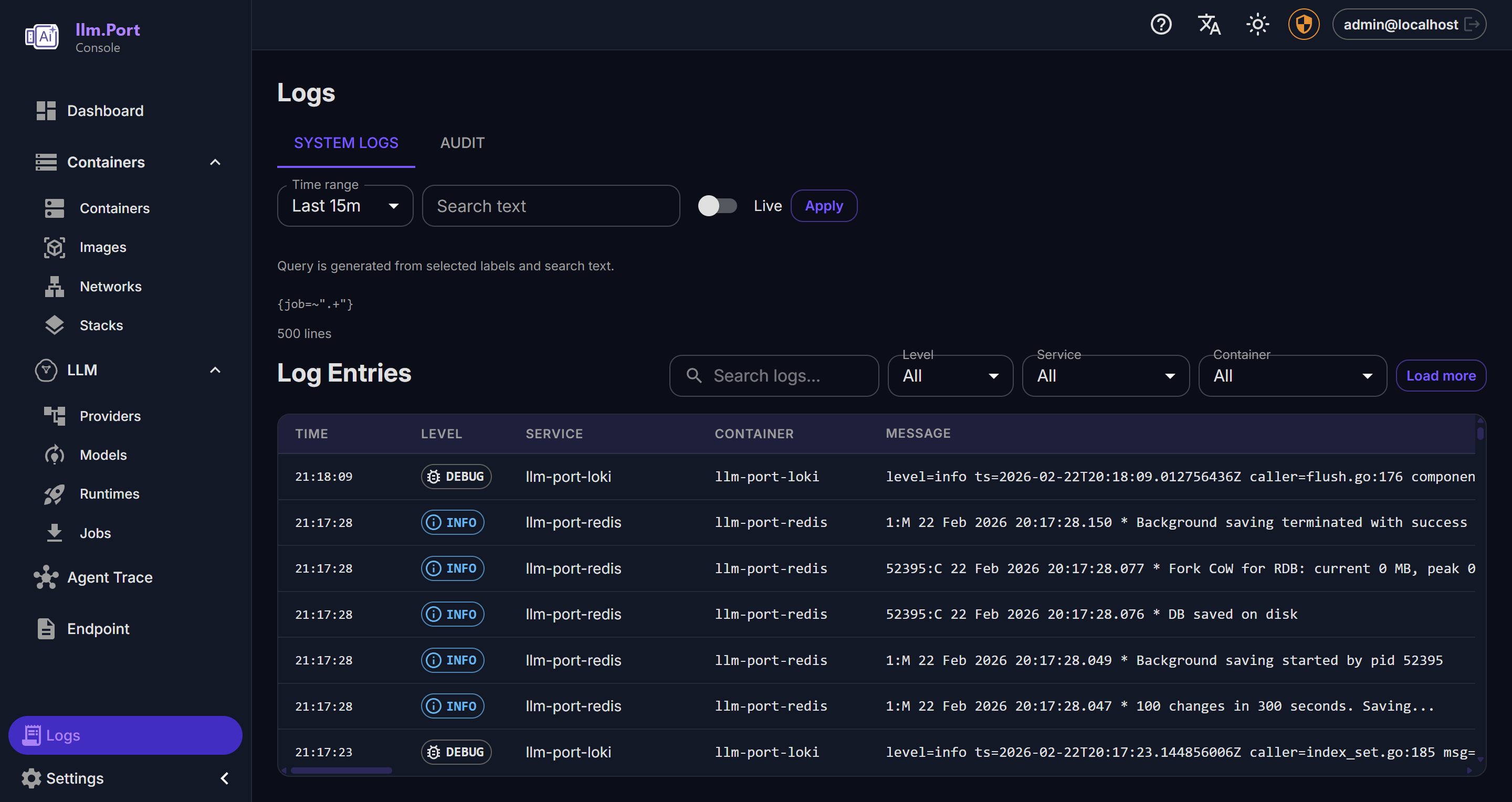

Observability

Langfuse für LLM-Tracing mit Datenschutzmodi. Grafana + Loki + Alloy für zentralisiertes Logging. OpenTelemetry + Jaeger für verteiltes Tracing. Prometheus-Metriken.

Control Plane

FastAPI-Backend für RBAC, Einstellungen, Docker-Orchestrierung, Modullebenszyklus, Agenten-Infrastruktur und Compose-Stack-Management mit Revisionsverfolgung.

Funktionen

Gateway & Routing

OpenAI-kompatibler API-Endpunkt (/v1/*), der Anfragen an lokale Runtimes (vLLM, llama.cpp, Ollama, TGI) und Remote-Anbieter (OpenAI, Azure, …) weiterleitet. Alias-basierte Modellauflösung, SSE-Streaming mit TTFT-Extraktion und automatische Wiederholung.

Sicherheit & PII

Vollständiges RBAC mit JWT-Authentifizierung, OAuth / SSO / OIDC, Redis-Rate-Limiting, Concurrency-Leasing und Fernet-verschlüsselten DB-Geheimnissen. Presidio-basierte PII-Erkennung mit mandantenspezifischen Richtlinien, konfigurierbaren Entitätstypen und Fail-Safe-Modi.

Observability

Langfuse-Tracing mit Datenschutzmodi, Loki + Alloy zentralisiertes Logging, OpenTelemetry + Jaeger verteiltes Tracing und ein Dashboard mit eingebetteten Grafana-Panels. Jede Gateway-Anfrage und Admin-Aktion wird im Audit-Log erfasst.

RAG-Pipeline

Mandantenfähiges Retrieval mit Vektor-, Stichwort- und Hybridsuche. Virtueller Container-Baum mit Entwurf-/Veröffentlichungs-Workflows, vorsignierte MinIO-Uploads, Collector-Plugins und asynchrone Verarbeitung über Taskiq + RabbitMQ.

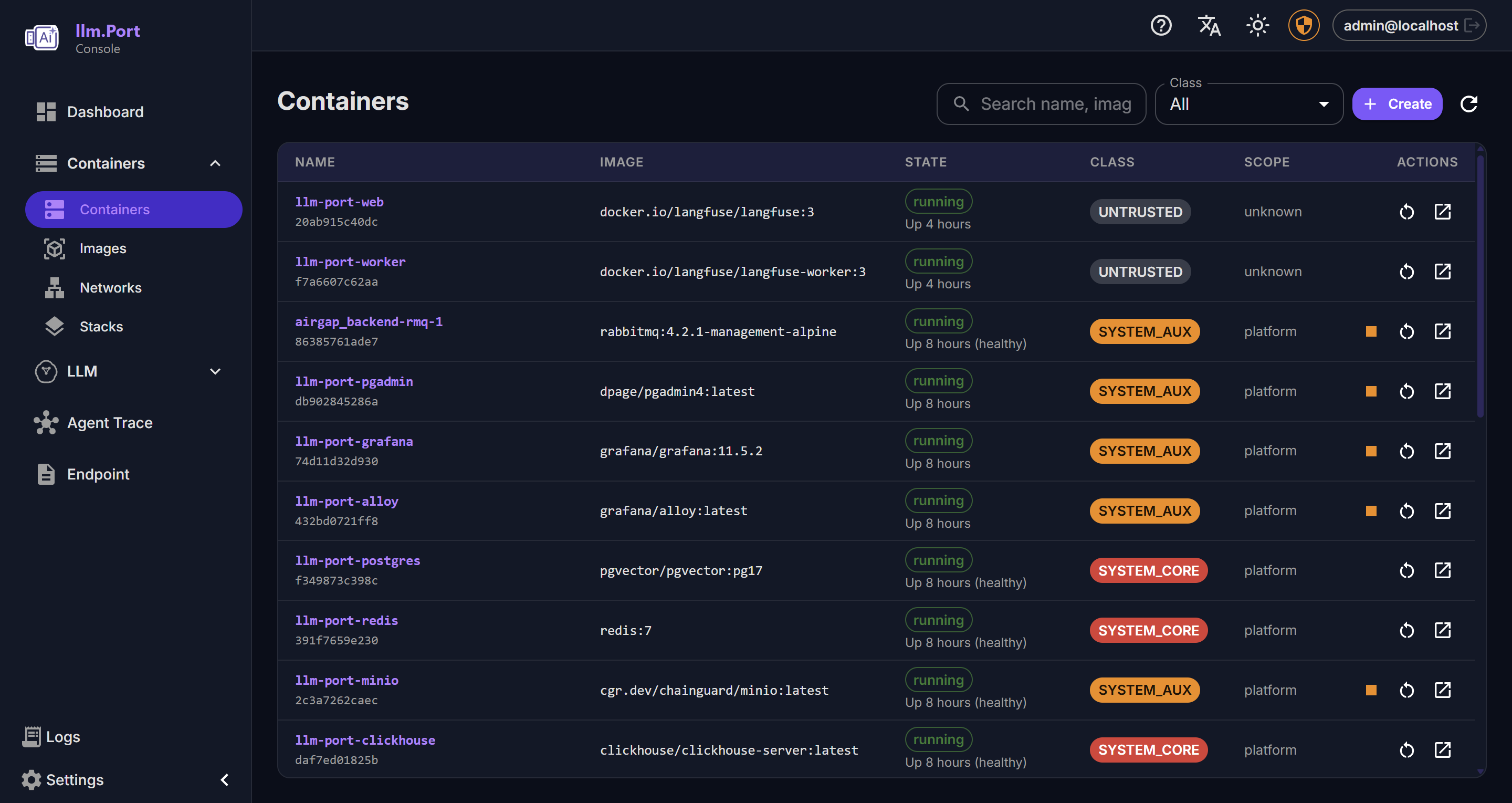

Ops-Konsole

Vollständiges Container-Lifecycle-Management, Image-Pulls mit SSE-Fortschritt, Compose-Stack-Deploy/Rollback mit Revisionen und Audit-Trail. Multi-Vendor-GPU-Erkennung (NVIDIA, AMD, Intel, Apple Metal).

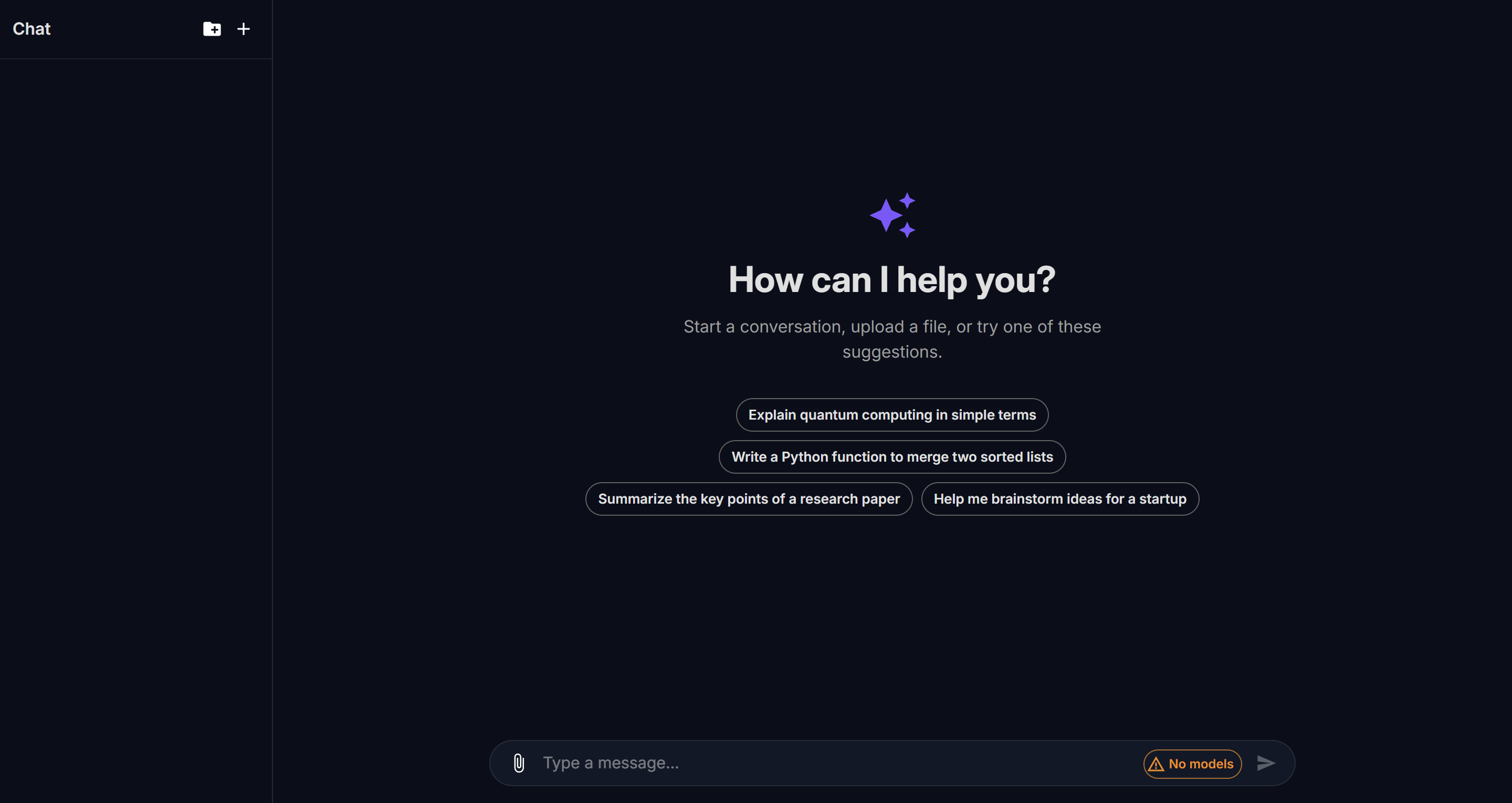

Chat-Konsole

Integrierte Chat-UI mit SSE-Streaming, Drag-and-Drop-Sitzungsverwaltung, Fehlerwiederholung, Dark-/Light-Theming und nutzungsbasiertem Tracking pro Modell. Unterstützt alle über das Gateway verbundenen Modelle.

llm.port im Vergleich

| Funktion | llm.port | LiteLLM | Ollama |

|---|---|---|---|

| OpenAI-kompatibles Gateway | ✅ | ✅ | ✅ |

| Admin-UI | ✅ Built-in | 💰 Paid | ❌ |

| PII-Schwärzungsschicht | ✅ Native | ❌ | ❌ |

| RAG-Pipeline | ✅ Built-in | ❌ | ❌ |

| Chat Console with Memory | ✅ | ❌ | ❌ |

| GPU-Erkennung | ✅ Auto-detect | ❌ | ✅ |

| Langfuse Tracing | ✅ Embedded | 🔌 Plugin | ❌ |

| Grafana + Loki Logging | ✅ Pre-configured | ❌ | ❌ |

| RBAC / Mandantenfähigkeit | ✅ | 💰 Partial | ❌ |

| i18n (4 Sprachen) | ✅ | ❌ | ❌ |

| CLI-Tooling | ✅ llmport deploy | ❌ | ❌ |

| License | Apache 2.0 | MIT + Paid | MIT |

Warum llm.Port

Souveräne KI als Standard — Daten bei Bedarf lokal halten, Remote-Anbieter nutzen wenn erlaubt, ohne Apps zu ändern oder Governance und Observability zu verlieren. Eine Plattform ersetzt ein Flickwerk aus Proxies, Dashboards und Skripten.

GTC 2026 Inferenz-Infrastruktur für Unternehmen

Teams, die die auf der GTC 2026 vorgestellten Modelle und Beschleuniger-Architekturen einsetzen, benötigen mehr als eine Runtime — sie brauchen ein sicheres Gateway. llm.port liefert die fehlende Produktionsschicht: ein OpenAI-kompatibles API-Gateway mit integrierter PII-Schwärzung, RBAC und vollständiger Observability — alles innerhalb Ihrer privaten VPC. Keine Daten verlassen Ihren Perimeter.

- Sicheres API-Gateway mit Rate-Limiting, Retry und alias-basiertem Modell-Routing

- PII-Schwärzung vor Ingress und Egress — Microsoft Presidio-basiert

- Multi-Vendor-GPU-Erkennung (NVIDIA CUDA, AMD ROCm, Intel) mit automatischer vLLM-Image-Auswahl

- Enterprise Observability: Langfuse LLM-Tracing, Grafana-Dashboards und OpenTelemetry

- Air-gapped, souveränes Deployment — keine externe Cloud-Abhängigkeit

Roadmap

Erweiterte OCR (Docling)

IBM Docling für erweiterte Dokumentenextraktion — Tabellen, Bilder, Seiten. Service-Gerüst vorhanden; Integration mit RAG-Pipeline in Arbeit.

Auth-Service (SSO / OIDC)

Dedizierter Auth-Service für externe Identity-Provider-Verwaltung. Framework und Compose-Profil definiert.

Mailer-Service

Dedizierter E-Mail-Versanddienst für Passwort-Resets, Admin-Benachrichtigungen und Systemeinladungen.

Enterprise Pro-Module

Lizenz-Framework bereit (Ed25519 JWT). Pro-Implementierungen für PII, RAG und Gateway in Kürze.

Weitere Runtimes

TensorRT-LLM, SGLang und weitere verwaltete API-Anbieter.

Feingranulare Kostenkontrolle

Nutzungsanalysen pro Mandant, Modell und Benutzer mit Budgetlimits und Chargeback-Unterstützung.

Screenshots

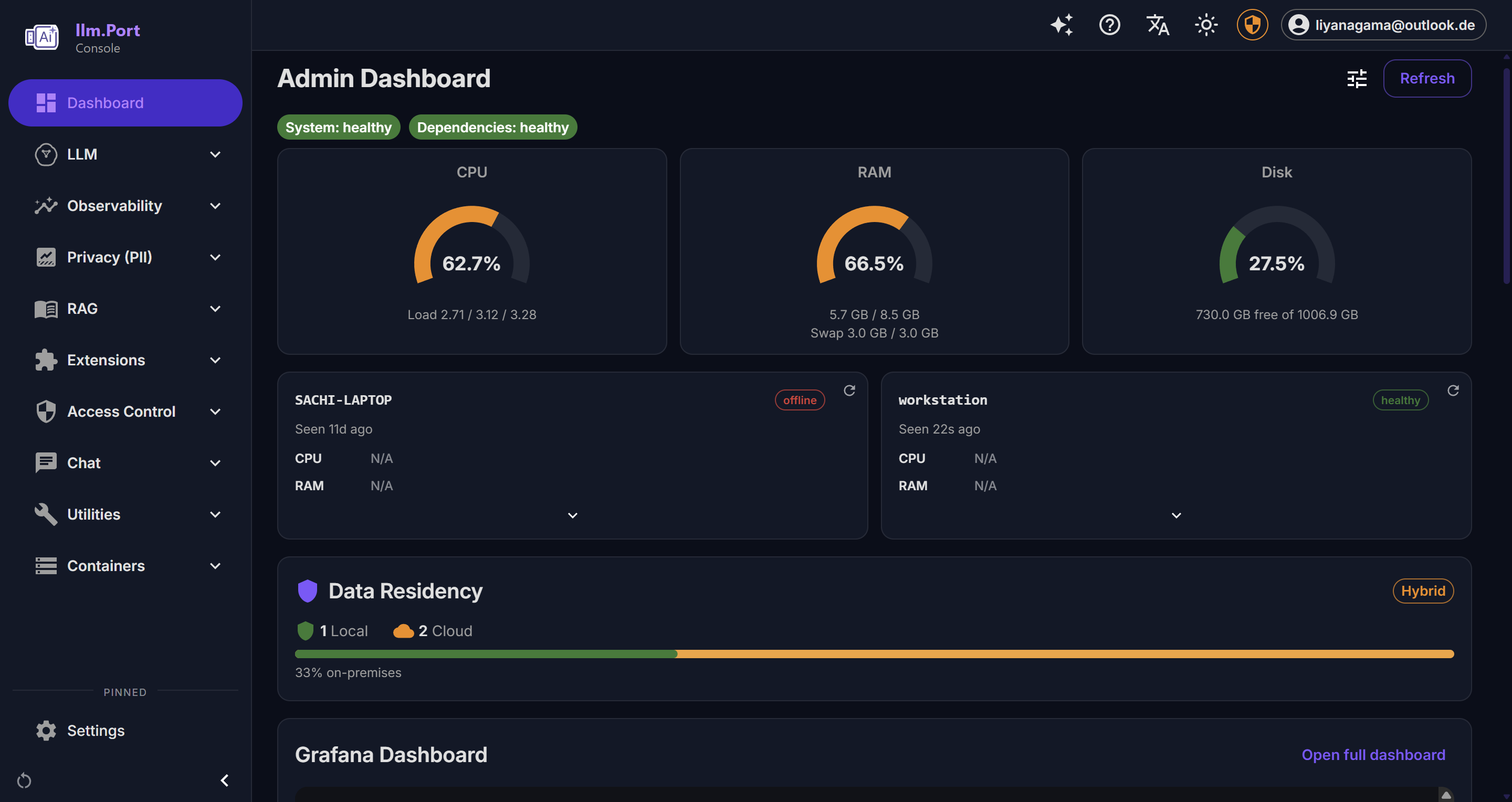

Dashboard

Dashboard Chat Console

Chat Console Container Management

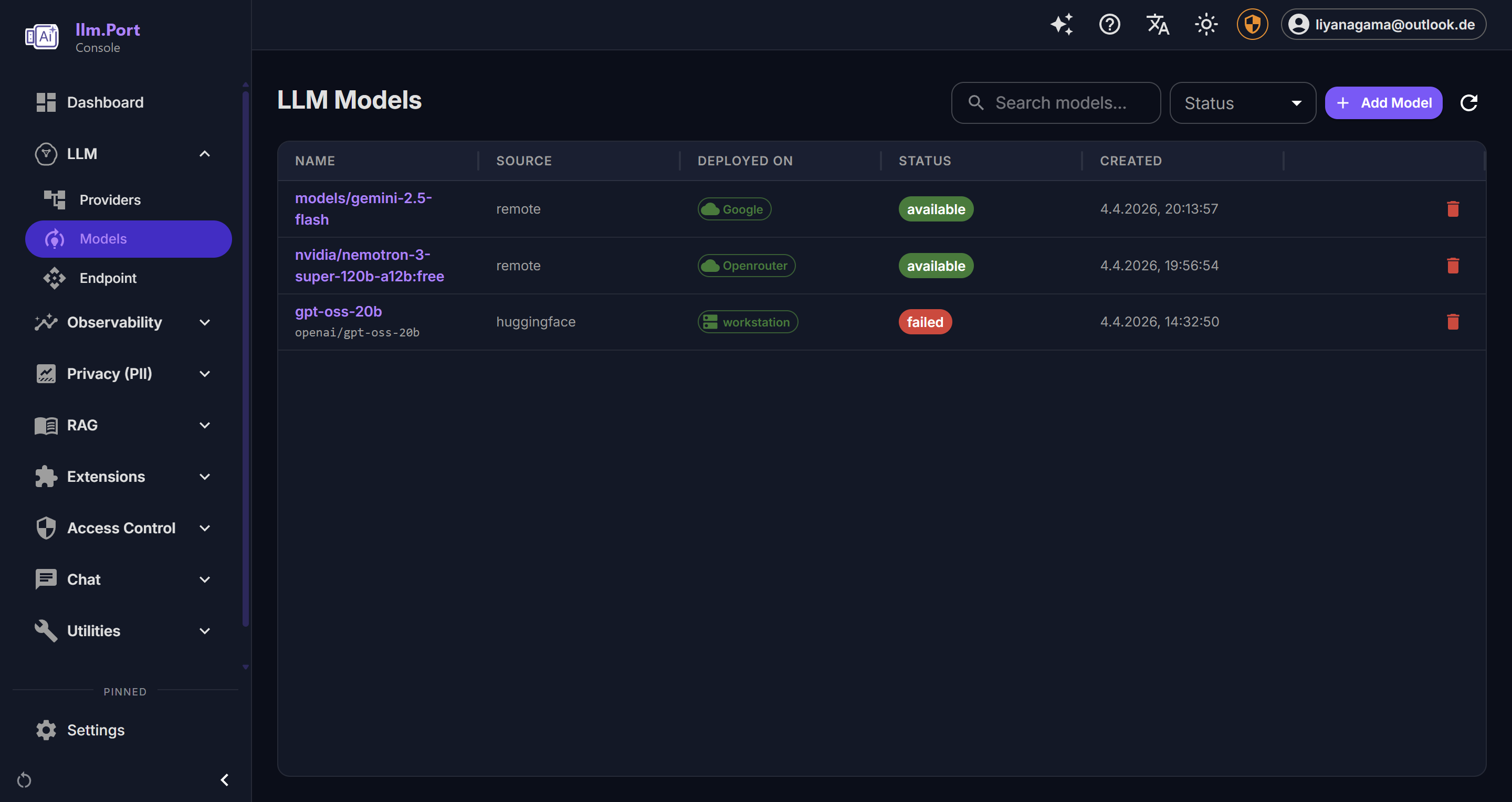

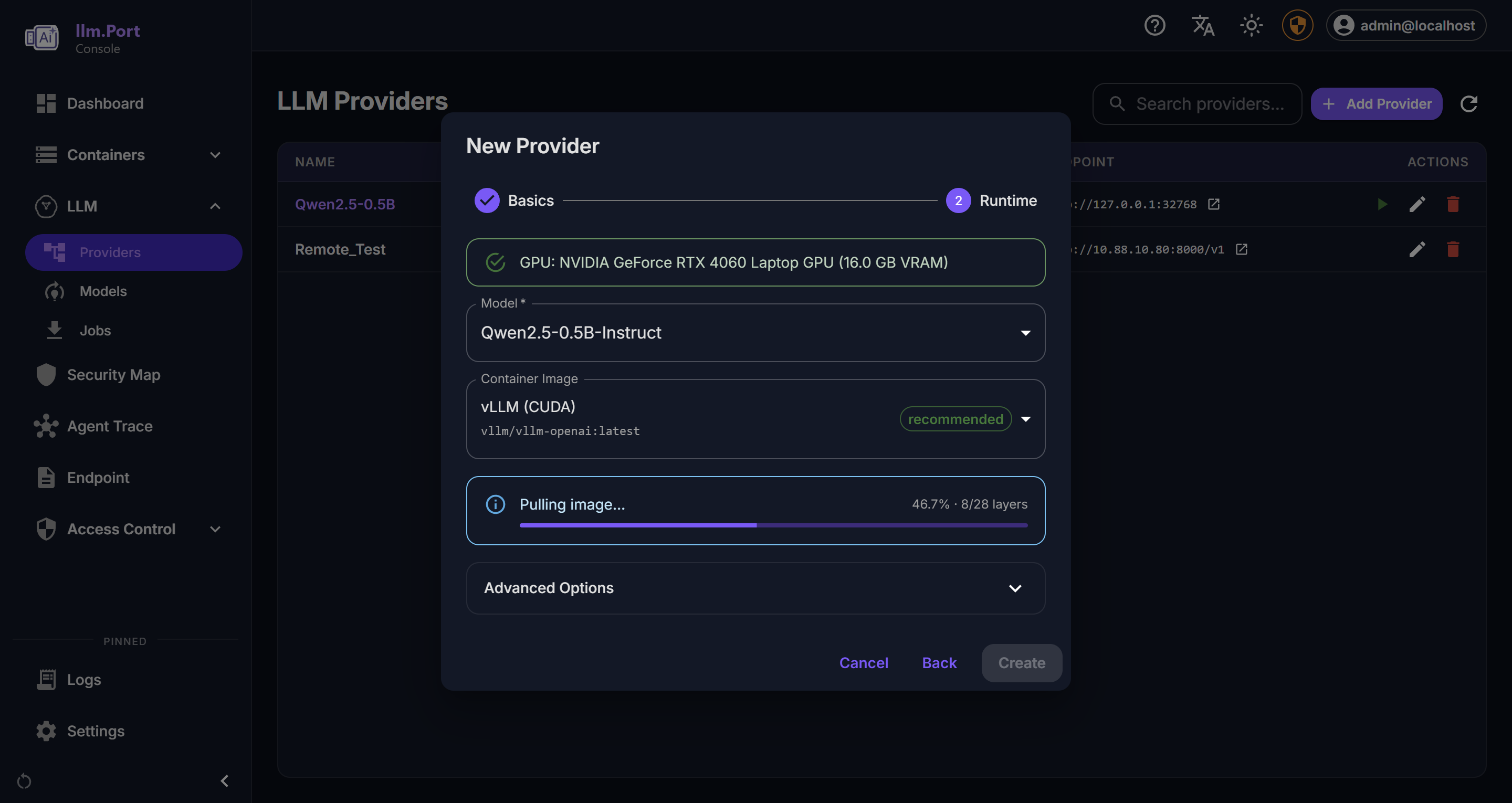

Container Management LLM Providers

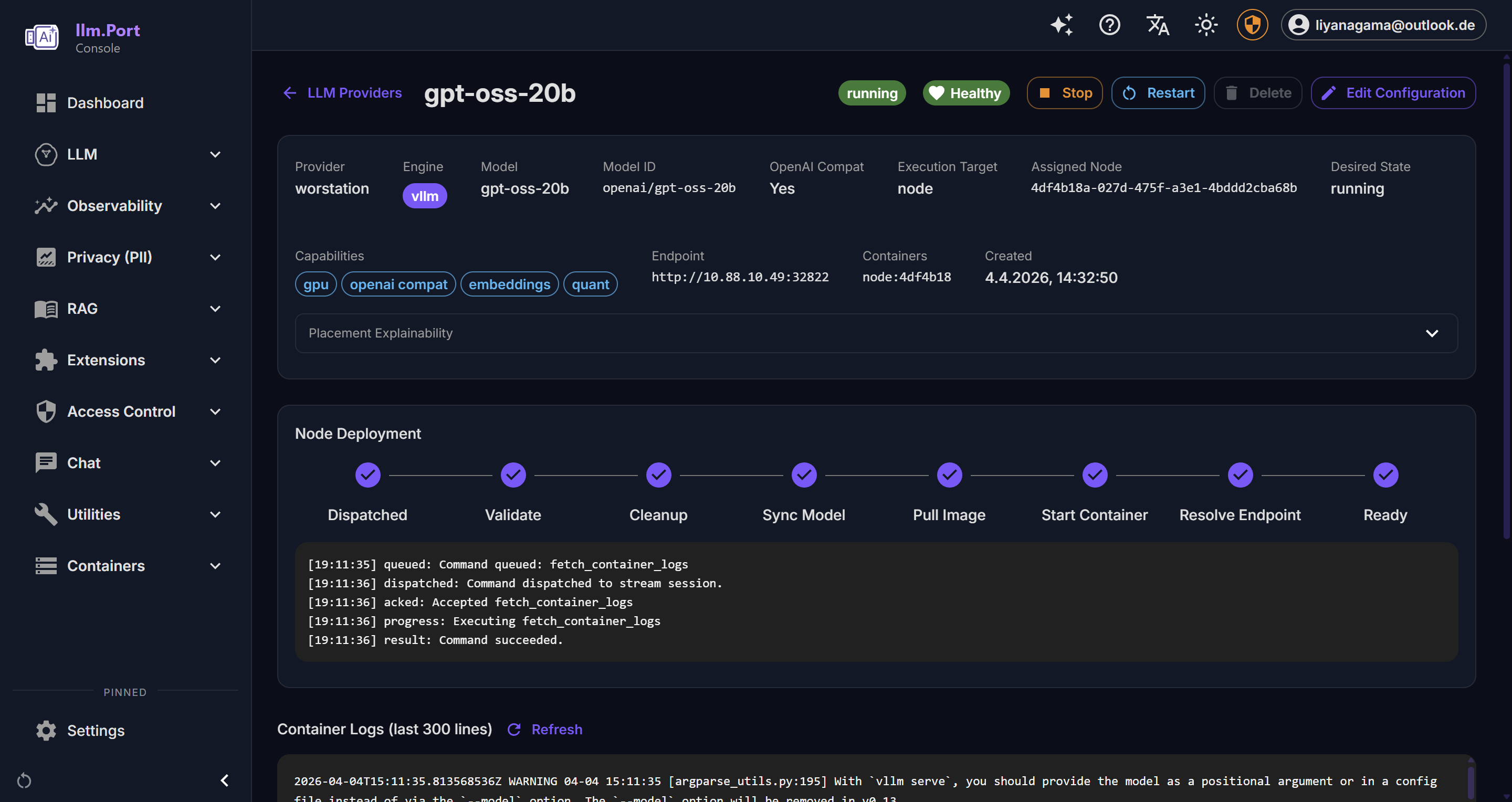

LLM Providers Provider Details

Provider Details Local Runtime

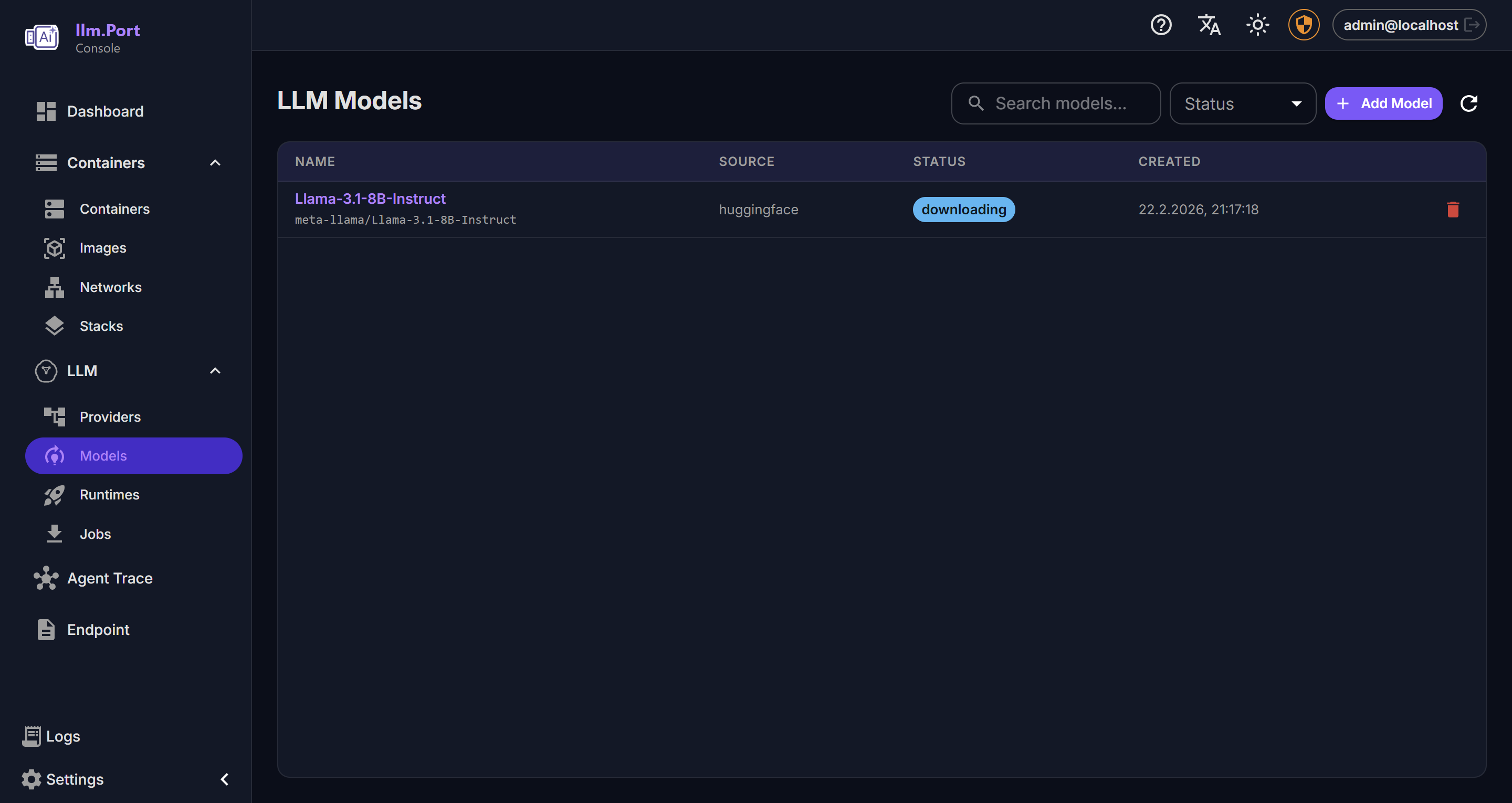

Local Runtime Models

Models Logging

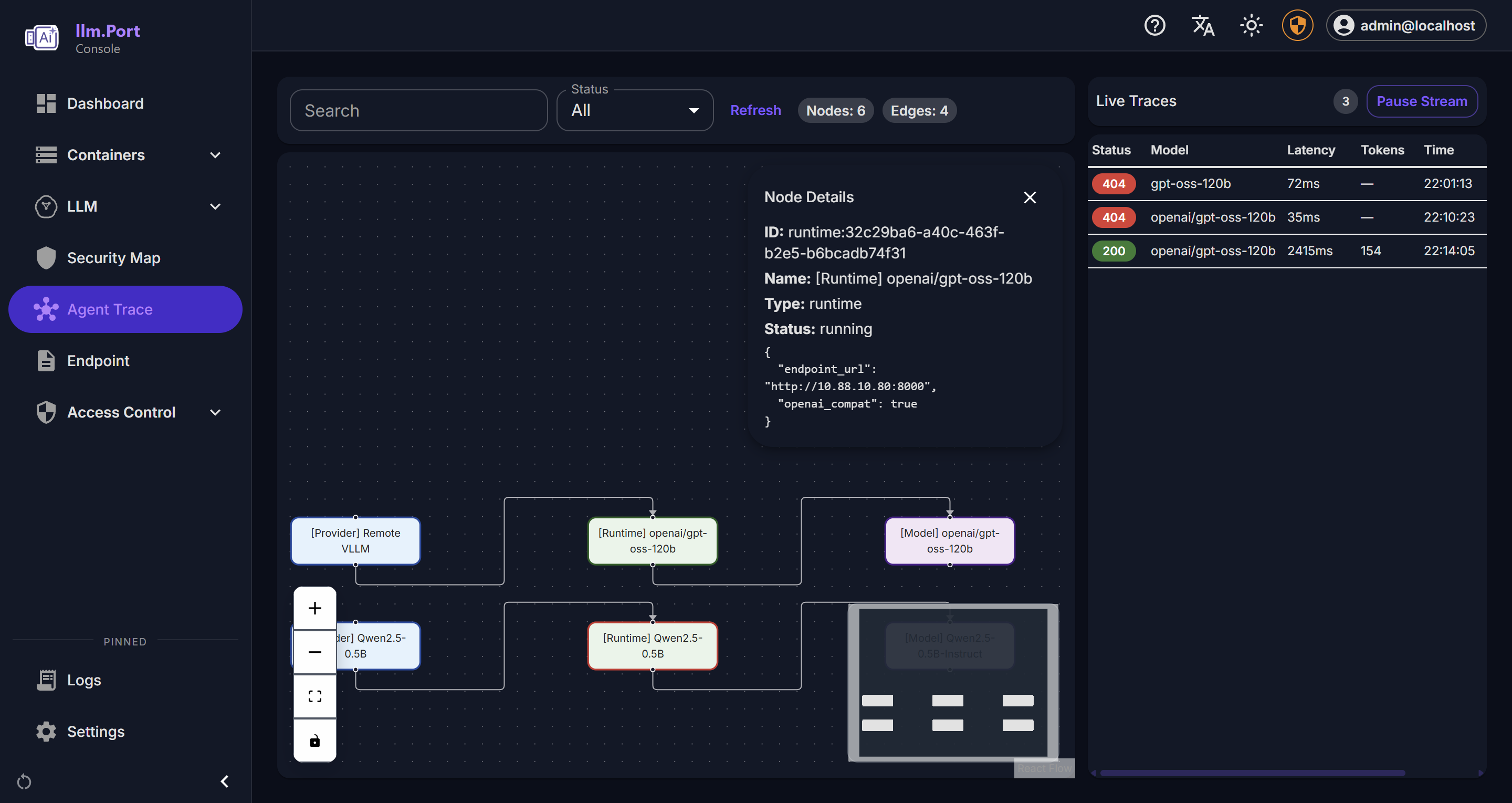

Logging Trace Viewer

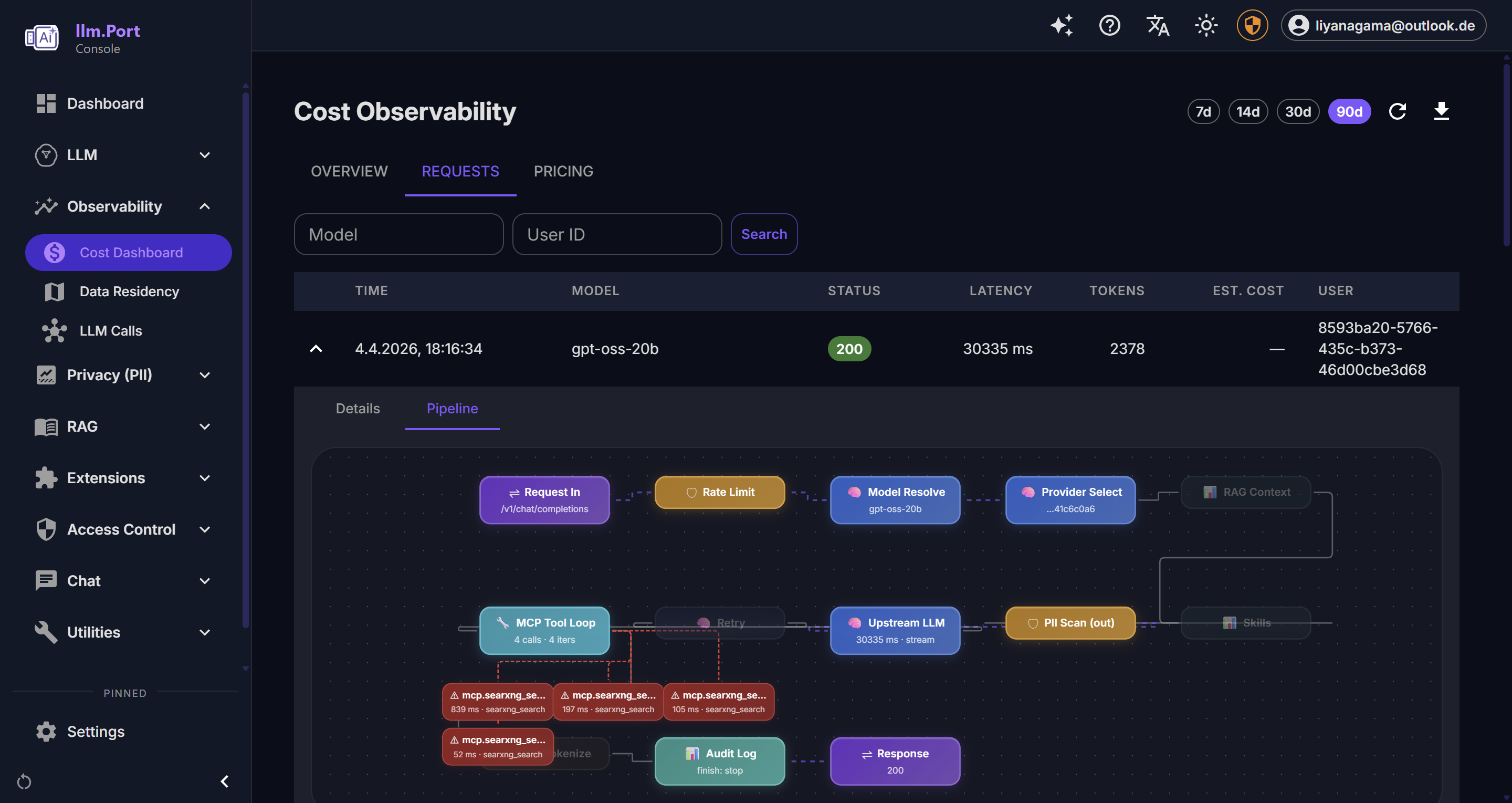

Trace Viewer Cost & Request Trends

Cost & Request Trends Security Overview

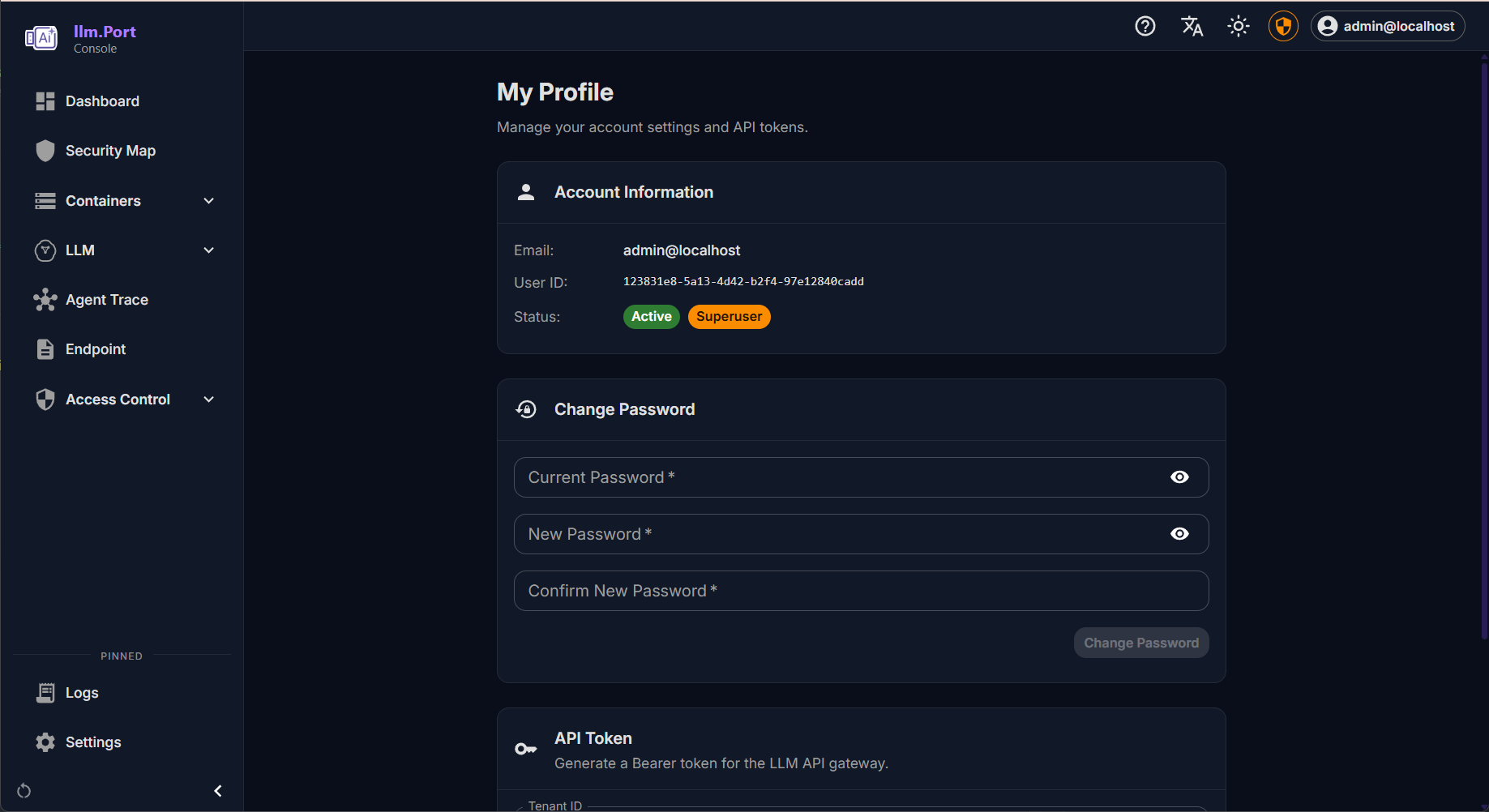

Security Overview User Profile

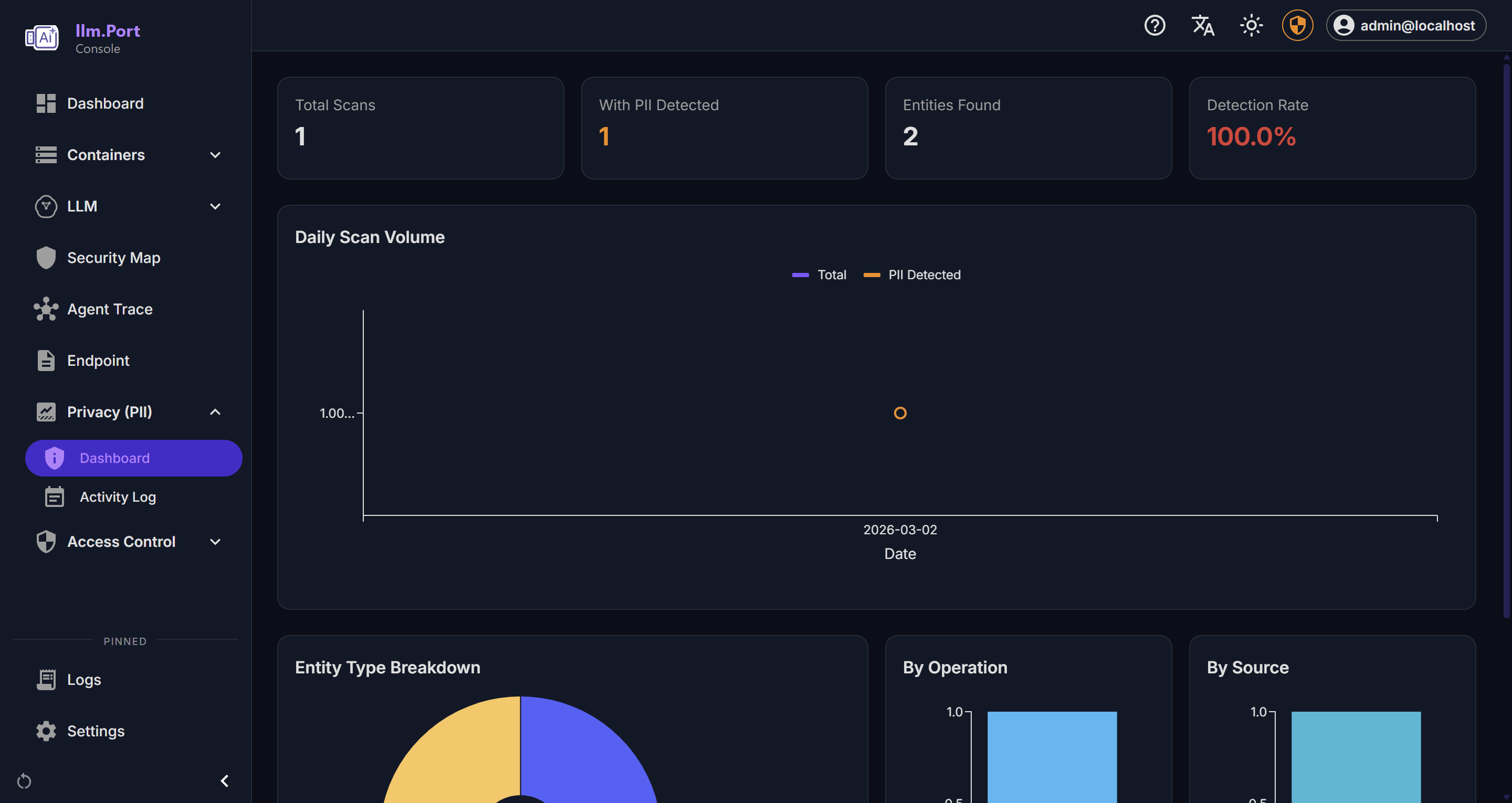

User Profile PII Detection

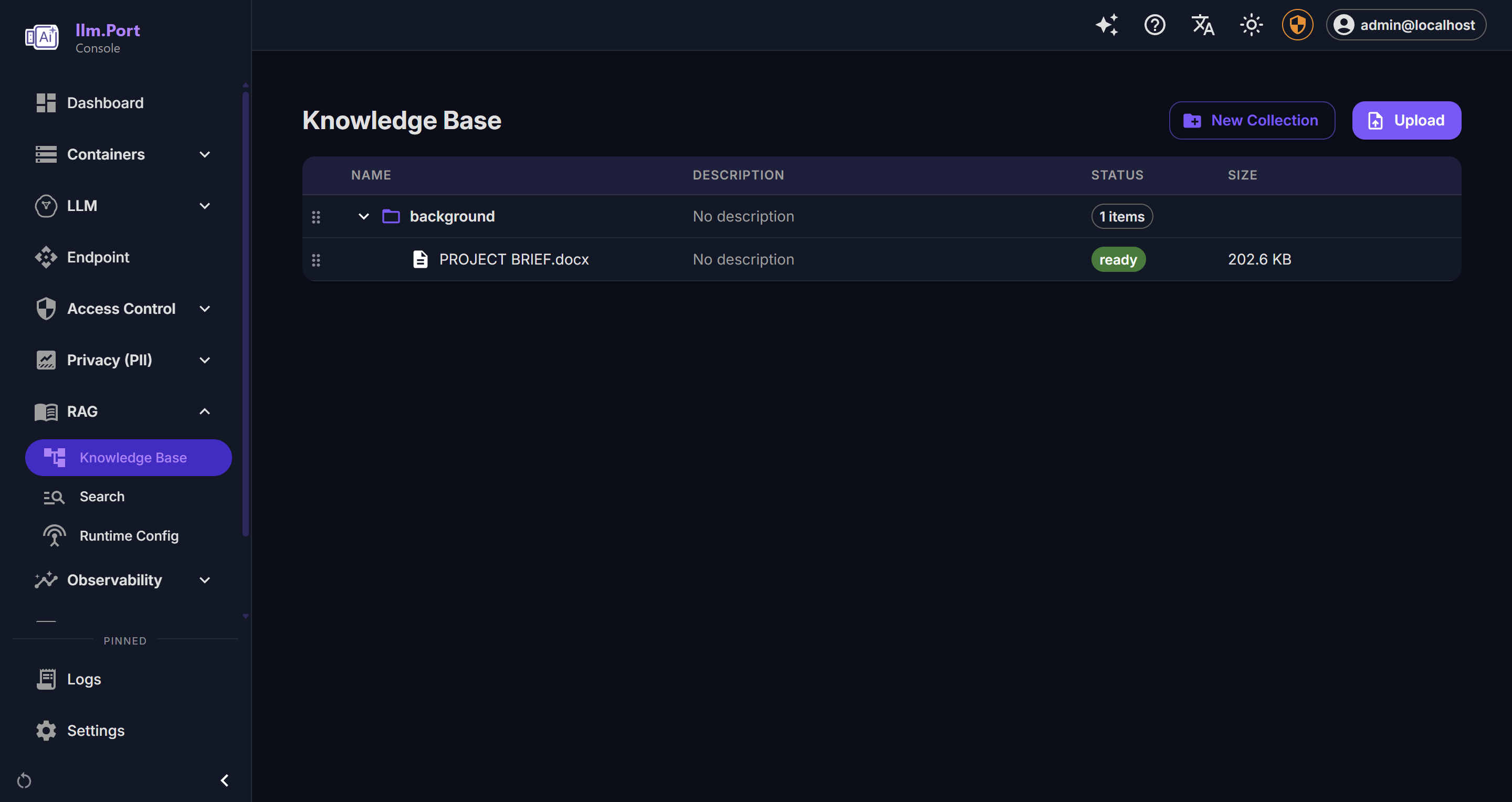

PII Detection Knowledge Base

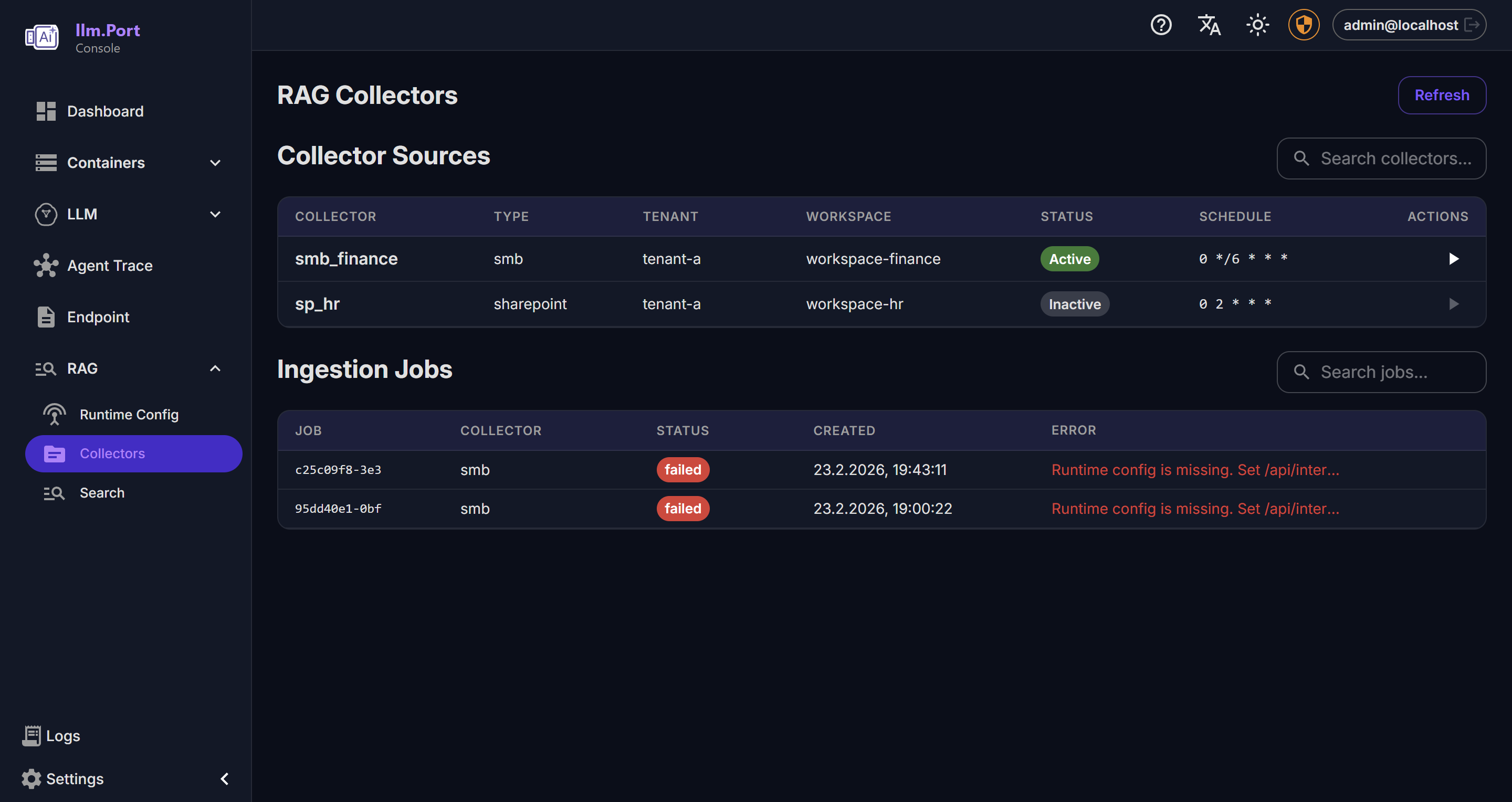

Knowledge Base RAG Collectors

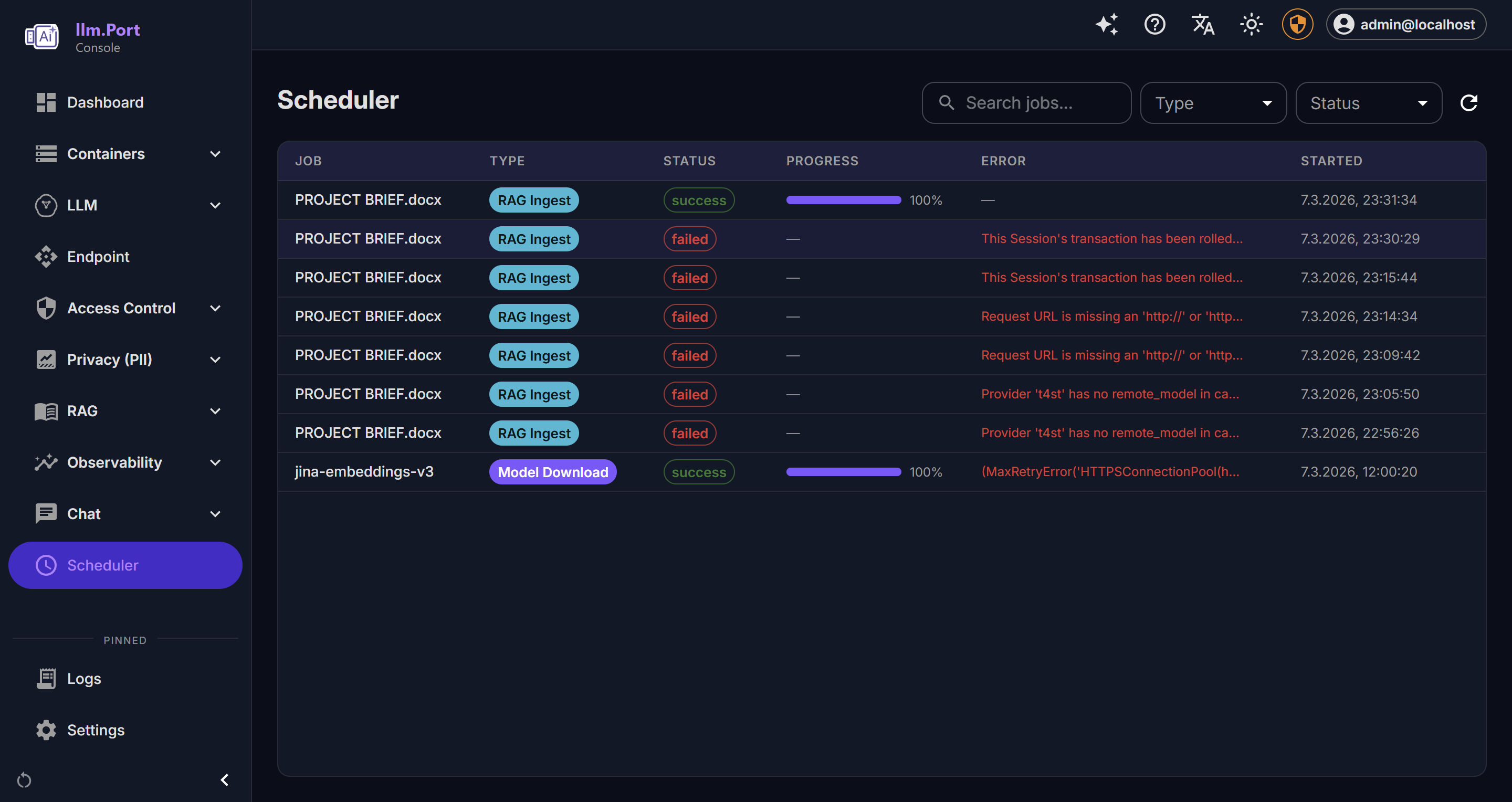

RAG Collectors Scheduled Publishing

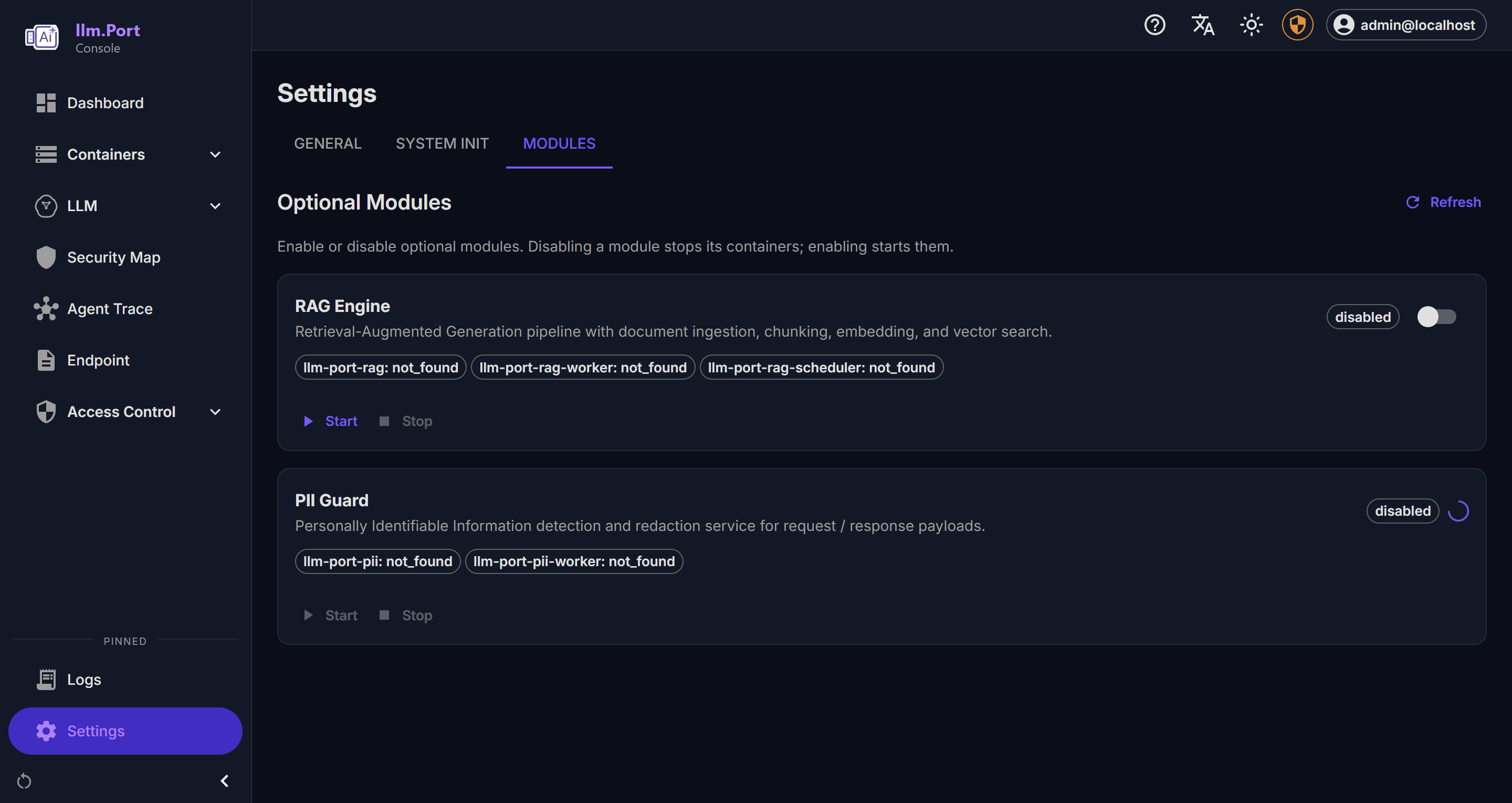

Scheduled Publishing Modules

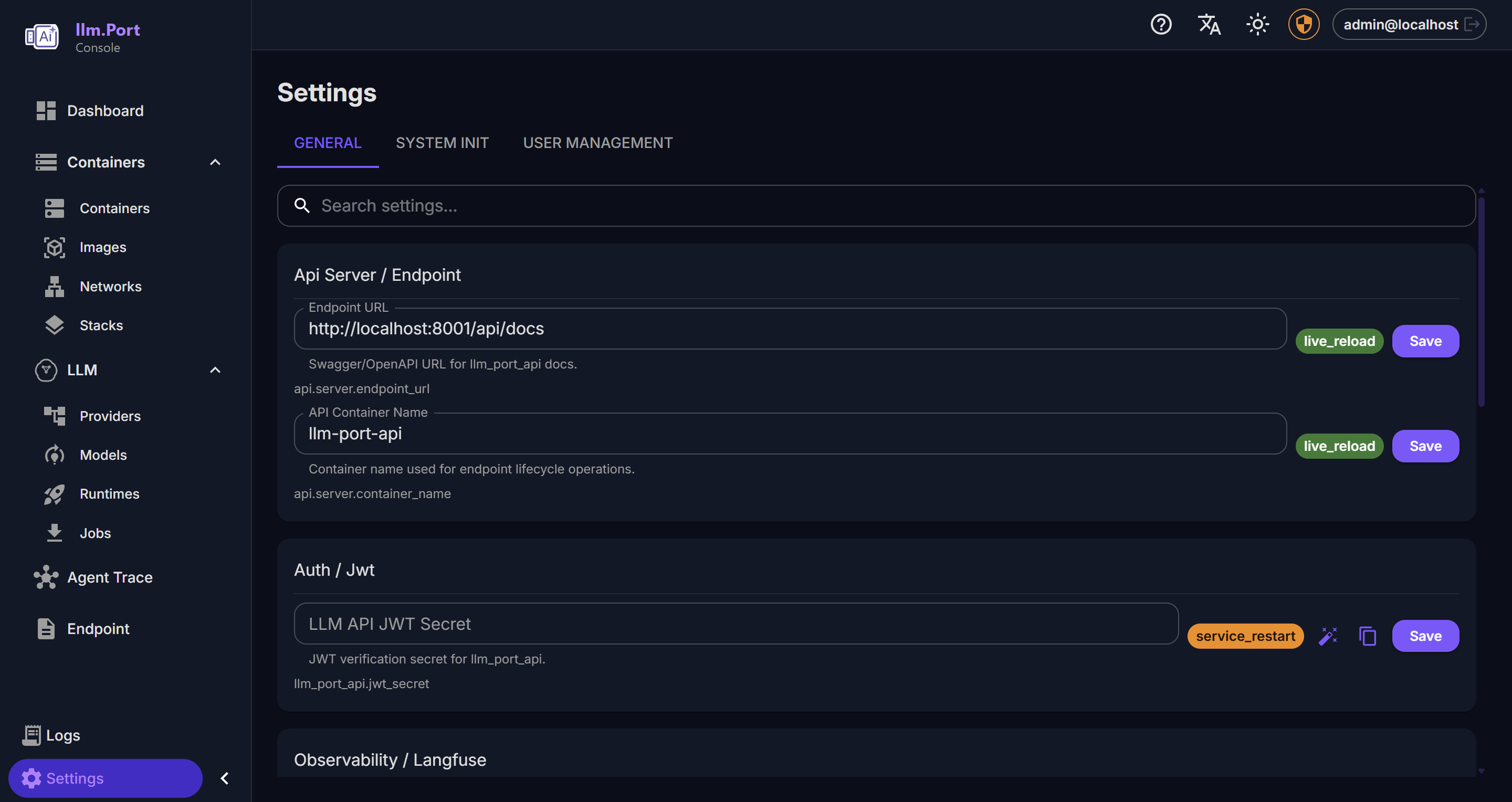

Modules Settings

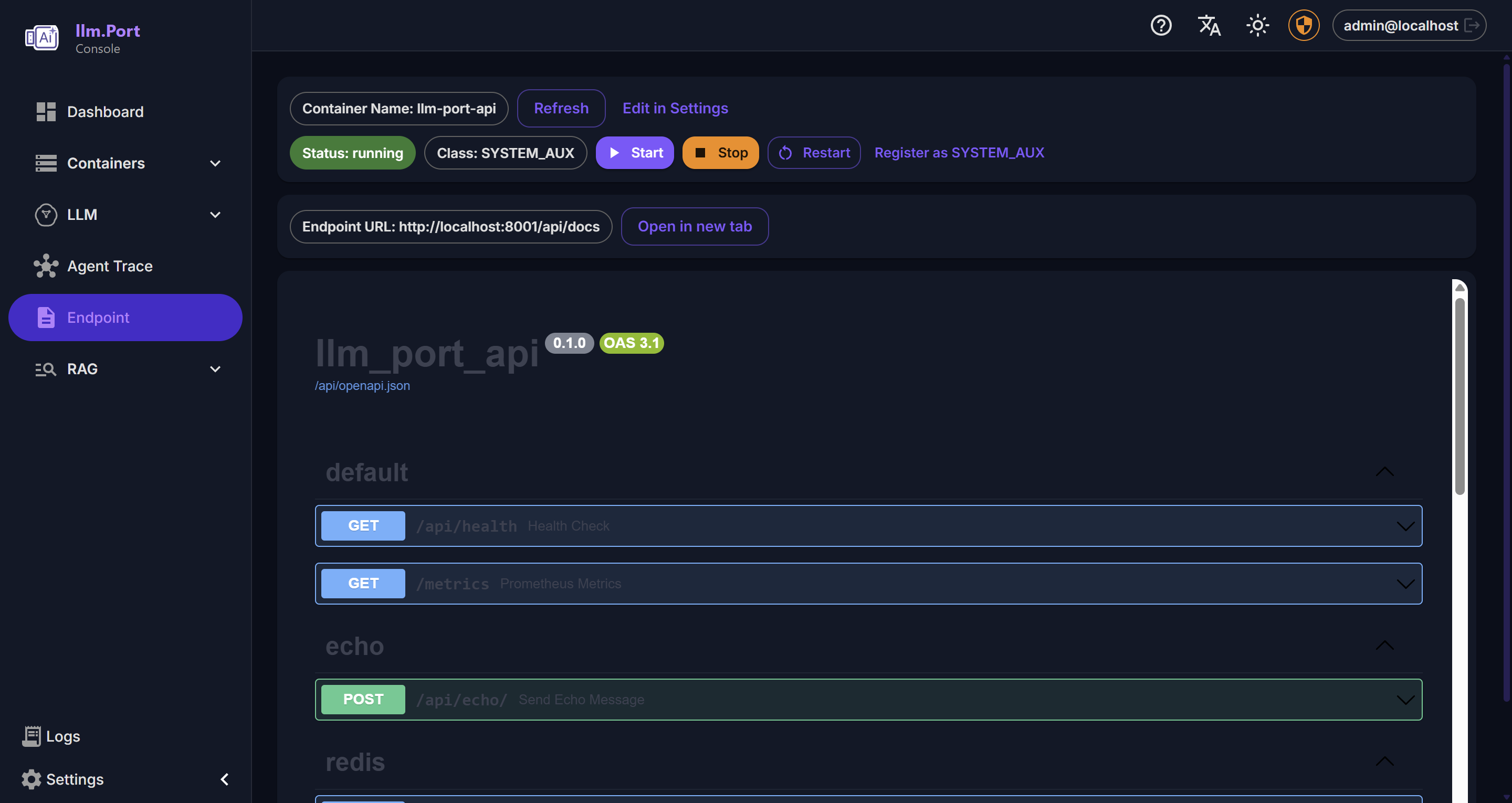

Settings API Playground

API PlaygroundEnterprise-Funktionen verfügbar für Teams, die SSO, erweiterte PII-Tokenisierung und Governance benötigen. Kontakt aufnehmen →