What is llm.port?

llm.port ist eine selbst gehostete AI-Workspace-Plattform, mit der Teams LLM-Features sicher und kontrolliert betreiben koennen.

Einfach gesagt bekommst du einen zentralen Ort, um:

- Modelle anzubinden (lokal oder gehostet)

- Berechtigungen und Richtlinien zu verwalten

- sensible Daten zu schuetzen

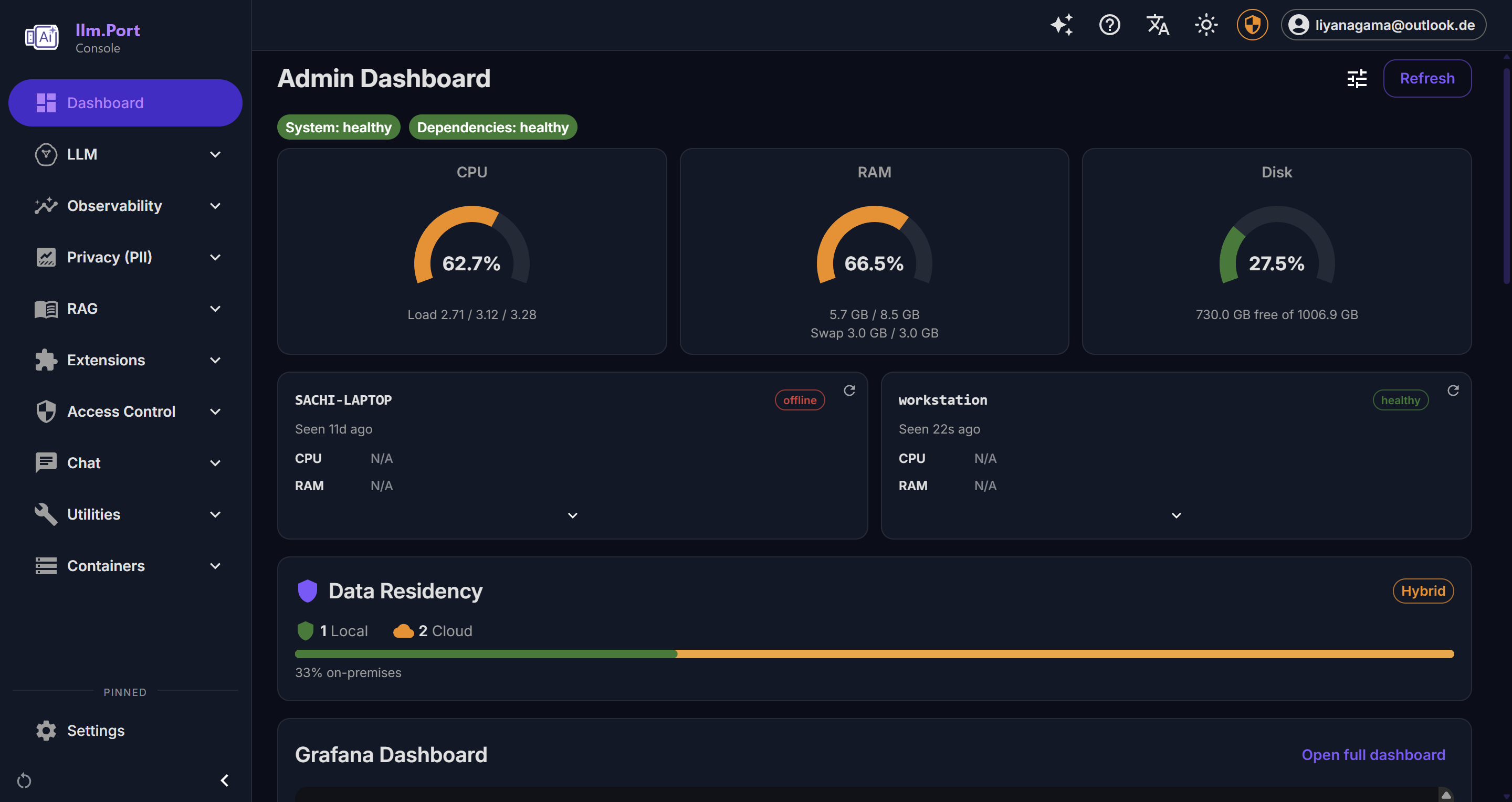

- Nutzung, Qualitaet und Kosten in einem Dashboard zu sehen

Was du damit tun kannst

- Ein Modell schnell bereitstellen und fuer Apps verfuegbar machen

- Governance einhalten, ohne Teams auszubremsen

- Requests, Fehler und Kosten ohne Extra-Tooling verfolgen

- Funktionen wie RAG oder PII-Controls bei Bedarf aktivieren

Who it is for

- Teams, die AI produktiv einsetzen wollen (nicht nur Demos)

- Sicherheitsorientierte Organisationen mit hohen Compliance-Anforderungen

- Produktteams, die AI-Features schneller liefern moechten

Why teams choose llm.port

- Schneller Start: von Installation bis zur ersten Anfrage in wenigen Minuten

- Sicherer Betrieb: Richtlinien, Audit-Transparenz und Privacy-Guardrails

- Flexible Architektur: lokale Modelle, gehostete Provider oder beides

Schnellansicht

Next steps

- Starte mit Quickstart

- Lies den Platform Overview

- Integriere ueber API Gateway